Spis treści:

W dzisiejszych czasach, kiedy internet stał się podstawowym źródłem informacji dla większości ludzi, istotne jest, aby strona internetowa była łatwo dostępna i widoczna dla użytkowników. W tym celu korzystamy z różnych technik optymalizacji(SEO), które pozwalają na lepsze pozycjonowanie strony w Lublinie. Jednym z narzędzi, które może pomóc w poprawie widoczności strony, jest plik robots.txt.

Czym jest plik robots.txt?

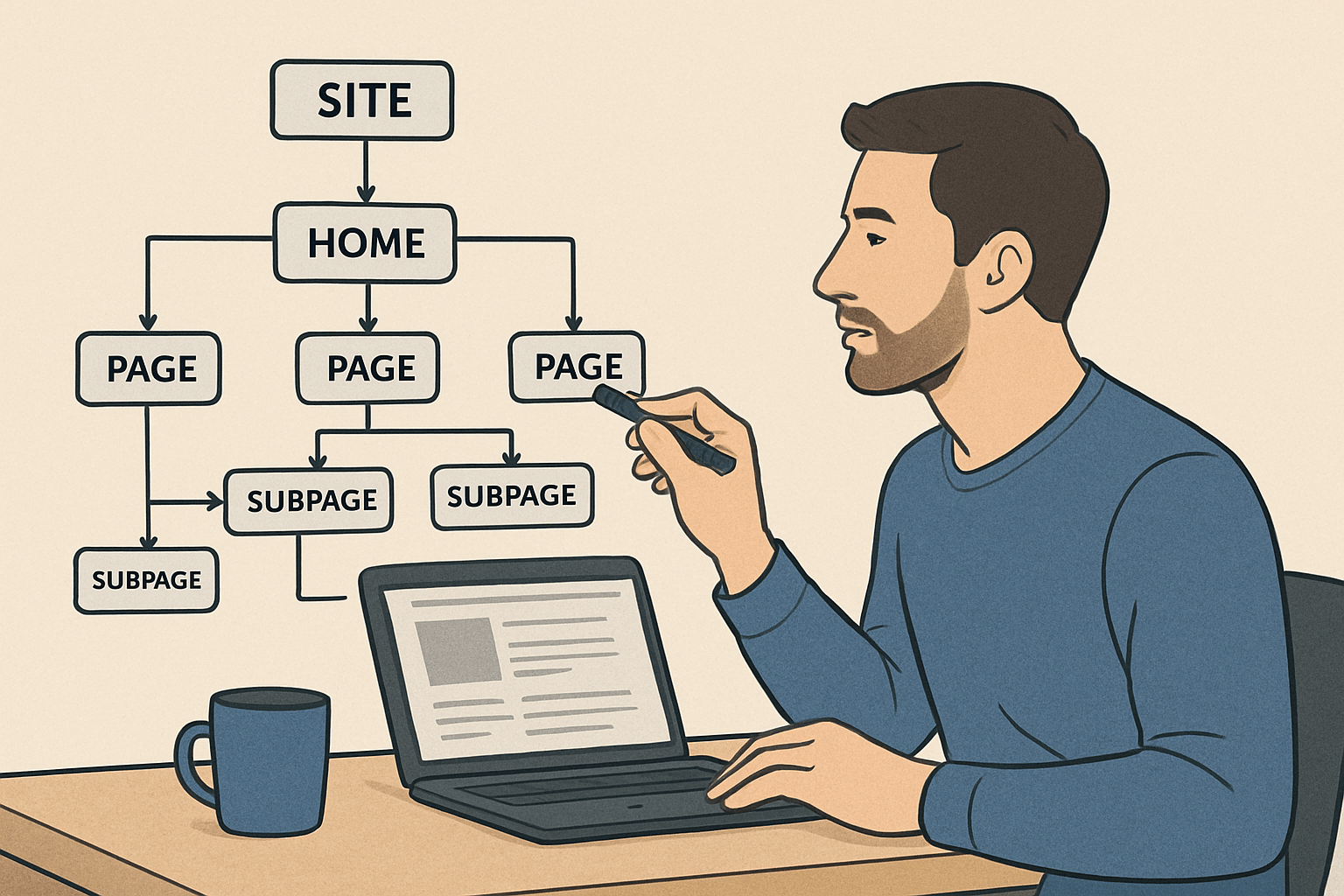

Plik robots.txt to prosty plik tekstowy, który jest umieszczany w głównym katalogu witryny internetowej. Służy on do komunikacji z robotami wyszukiwarek internetowych (takimi jak Googlebot czy Bingbot), które odwiedzają i indeksują strony internetowe, aby potem wyświetlać je w wynikach wyszukiwania. Plik robots.txt pozwala na udzielenie instrukcji tym robotom co do tego, które części witryny mają być indeksowane, a które mają zostać pominięte.

Jaki wpływ ma plik robots.txt na SEO?

Chociaż plik robots.txt nie jest bezpośrednio związany z optymalizacją strony pod kątem wyszukiwarek, ma on wpływ na sposób, w jaki roboty indeksują zawartość witryny. Dzięki niemu można zarządzać zasobami witryny, które mają być indeksowane, a które mają pozostać niewidoczne dla wyszukiwarek. Prawidłowo skonfigurowany plik robots.txt może pomóc w lepszym wykorzystaniu zasobów botów i sprawić, że strona będzie lepiej widoczna w wynikach wyszukiwania.

Oto kilka aspektów, na które wpływa plik robots.txt w kontekście SEO:

- Ograniczenie indeksowania nieistotnych stron: Plik robots.txt pozwala na zablokowanie dostępu do stron, które nie mają wartości dla użytkowników, takich jak strony z błędami, strony testowe czy strony z duplikatami treści. Dzięki temu roboty skupią się na indeksowaniu wartościowych stron, co może zwiększyć ich widoczność w wynikach wyszukiwania.

- Chronienie prywatności: Za pomocą pliku robots.txt można zablokować indeksowanie stron zawierających wrażliwe dane, takie jak informacje o użytkownikach czy dane logowania. Pomaga to zachować prywatność i zabezpieczyć witrynę przed nieuprawnionym dostępem do tych danych.

- Zarządzanie zasobami botów: Roboty wyszukiwarek mają ograniczone zasoby, co oznacza, że nie mogą odwiedzać każdej strony na świecie w nieskończoność. Plik robots.txt pozwala na lepsze wykorzystanie tych zasobów poprzez wskazanie stron, które mają być indeksowane, a które mają zostać pominięte. Dzięki temu roboty mogą skupić się na ważnych stronach, co może przyczynić się do poprawy widoczności strony w wynikach wyszukiwania.

- Zapobieganie duplikacji treści: Plik robots.txt może pomóc w kontrolowaniu problemu duplikacji treści na witrynie, który może wpłynąć na pozycjonowanie strony. Przykładowo, może się zdarzyć, że strona dostępna jest zarówno z prefiksem "www", jak i bez niego, co może być uznane za duplikat treści. Plik robots.txt pozwala na zablokowanie indeksowania jednej z tych wersji, co może pomóc w rozwiązaniu tego problemu.

- Optymalizacja ładowania strony: Często strony internetowe zawierają zasoby, które nie muszą być indeksowane przez roboty, takie jak skrypty JavaScriptowe czy arkusze stylów CSS. Pomimo że nie są one bezpośrednio widoczne dla użytkownika, mogą obciążać serwery i spowalniać indeksowanie pozostałej treści. Plik robots.txt umożliwia wykluczenie takich zasobów z procesu indeksowania, co może przyspieszyć ładowanie strony i jej indeksowanie.

- Eksperymentowanie z ustawieniami: Plik robots.txt jest również użytecznym narzędziem eksperymentalnym. Pozwala on na testowanie różnych strategii dotyczących indeksowania i obserwowanie, jak zmiany wpłyną na widoczność strony w wynikach wyszukiwania. Jest to szczególnie wartościowe dla SEO, ponieważ pozwala na zoptymalizowanie strategii w sposób, który najlepiej służy konkretnej stronie.

Podsumowując, plik robots.txt stanowi kluczowy element optymalizacji SEO, umożliwiający lepszą kontrolę nad tym, jak witryna jest indeksowana i postrzegana przez wyszukiwarki. Jego właściwe skonfigurowanie potrafi znacząco wpłynąć na widoczność stron w internecie, co czyni go niezbędnym narzędziem dla każdego webmastera dążącego do zoptymalizowania swojej obecności online.

Jak prawidłowo skonfigurować plik robots.txt?

Aby prawidłowo skonfigurować plik robots.txt i zwiększyć skuteczność pozycjonowania strony internetowej, warto przyjrzeć się nie tylko podstawowym elementom, ale również zagłębić się w zaawansowane aspekty konfiguracji i stosowania tego pliku. Oto szczegółowe wskazówki dotyczące optymalizacji pliku robots.txt:

Rozszerzone Dyrektywy

- Crawl-delay: Ta dyrektywa umożliwia określenie opóźnienia (w sekundach) pomiędzy kolejnymi próbami odwiedzenia strony przez roboty wyszukiwarek. Jest to szczególnie użyteczne na stronach, które doświadczają dużego obciążenia, pozwalając na ograniczenie wpływu robotów na wydajność serwera.

- Noindex: Chociaż formalnie dyrektywa ta nie jest częścią standardu robots.txt, niektóre wyszukiwarki pozwalają na jej użycie w pliku robots.txt jako sygnał, by nie indeksować określonych stron. Należy jednak pamiętać, że skuteczniejszym sposobem kontrolowania indeksowania jest użycie metatagu noindex bezpośrednio w kodzie HTML danej strony.

Praktyczne Porady do Konfiguracji

- Dokładność Ścieżek: Podczas określania ścieżek w dyrektywach Disallow i Allow, należy zachować precyzję. Roboty wyszukiwarek rozróżniają litery wielkie i małe, więc "Disallow: /Folder" i "Disallow: /folder" będą traktowane jako dwie różne ścieżki.

- Minimalizm: Staraj się unikać nadmiernego ograniczania robotów, szczególnie jeśli Twoja strona zmienia się i rośnie. Zbyt wiele zabronionych ścieżek może przeszkodzić w efektywnym indeksowaniu strony.

- Testowanie: Po dokonaniu zmian w pliku robots.txt warto skorzystać z narzędzi do testowania dostępnych w konsolach dla webmasterów (takich jak Google Search Console). Pozwoli to na sprawdzenie, czy plik działa zgodnie z oczekiwaniami, nie blokując dostępu do ważnych zasobów witryny.

Przykładowa Konfiguracja Pliku robots.txt

User-agent: *

Disallow: /tmp/

Disallow: /private/

Allow: /public/

Crawl-delay: 10

Sitemap: https://www.twojastrona.pl/sitemap.xml

Zastosowanie powyższych zaleceń pozwoli na skuteczniejsze wykorzystanie pliku robots.txt w procesie optymalizacji strony pod kątem SEO. Zapewni to lepszą widoczność w wynikach wyszukiwania, a tym samym większy ruch na stronie. Pamiętaj jednak, że plik robots.txt jest tylko jednym z elementów strategii SEO i powinien być stosowany w połączeniu z innymi optymalizacjami, takimi jak poprawa jakości treści, szybkości ładowania strony oraz jej struktury.

Podsumowanie

Plik robots.txt jest ważnym narzędziem, które może pomóc w optymalizacji strony pod kątem wyszukiwarek, dzięki lepszemu zarządzaniu indeksowaniem zawartości witryny. Prawidłowo skonfigurowany plik robots.txt może zwiększyć widoczność strony w wynikach wyszukiwania oraz ułatwić robotom wyszukiwarek indeksowanie wartościowych stron. Warto więc poświęcić czas na zrozumienie działania pliku robots.txt oraz na jego właściwą konfigurację, aby w pełni wykorzystać jego potencjał w kontekście SEO.